D'après le hacker chpwn, il sera bientôt possible d'ajouter ses propres commandes à Siri d'ici quelques temps et ce sans jailbreak.

Le célèbre hacker chpwn a récemment annoncé via son compte twitter qu'avec l'aide d'un autre hacker, Aman Gupta alias @tmm1, ils avaient réussi l'exploit d'intégrer à Siri des commandes non fournies par Apple. Nombreux sont les possesseurs d'iPhone 4S à s'être amusés à torturer Siri en lui posant tout plein de questions parfois peu orthodoxes et cela ravivera sûrement d'anciens jeux.

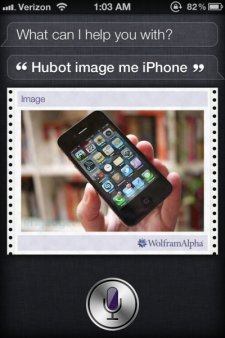

Remarquons qu'ici, l'utilisateur utilise une tournure de phrase assez incompréhensible mais Siri semble comprendre...

Comment cela peut être possible, surtout sans jailbreak ? Eh bien la réponse est assez "simple". tmm1 a modifié des proxies et ainsi forcé les serveurs d'Apple à répondre à des commandes auxquels ils n'étaient pas censés répondre. Les commandes qui pourront être intégrées et la façon dont cela a été fait reste assez vague mais les précisions devraient arriver avec le temps. Les hackers indiquent toutefois que cette modification ne sera pas accessible à tous du fait de sa complexité.